从训练 Scaling 到推理 Scaling,算力竞赛仍将继续

在多位大模型研究者看来,o1 最重要的变化是展现出了一种大幅提升大模型能力的新路径。

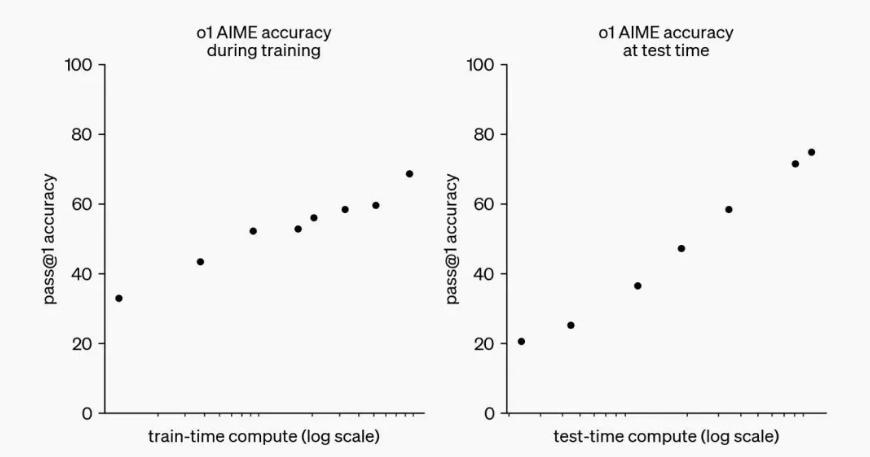

原来的 Scaling Laws 意味着,用更多数据和算力训练出参数更大的模型,性能就会更好。

而如下图, o1 展现出,让模型花更多时间、更多算力回答问题(test-time compute),性能也会持续提升。英伟达资深 AI 科学家 Jim Fan 在社交媒体上说,这可能是自 2022 年 DeepMind 提出 Chinchill Scaling Laws(原版 Scaling Laws 上的一个优化)以来,大模型研究中最重要的一张图。

Jim Fan 还提出了大模型未来演进的一种可能:未来的模型可能将推理与知识分离,有小的 “推理核心”,同时也用大量参数来记忆事实(知识),以便在琐事问答等测试中表现出色。

OpenAI 也在介绍 o1 的文章中特意提到,他们会继续开发 GPT 系列的模型。这可能预示,OpenAI 会把 o1 中使用的方法引入到下一代 GPT 模型中。

不管是 o1 成为新的主流方法,还是 o1 与 GPT 系列结合,演化出下一代大模型,算力需求应该都会进一步提升。

OpenAI 未公开 o1 系列的推理成本,但从 o1 模型回答问题的时长和 OpenAI 对 o1 的使用限制可以推测,o1 相比 GPT 系列需要庞大得多的推理算力资源。

每月花 20 美元的 ChatGPT Plus 付费用户,目前每周只能用 30 次 o1-preview 和 50 次 o1-mini。而目前 GPT-4o 的限制是每周 4480 次(每 3 小时 80 次),是 o1-mini 的 90 倍,o1-preview 的 150 倍。

o1-preview 回答问题的时间从 GPT 系列模型的秒级增加到了数十秒、甚至更久。它回答问题时处理的文本量也大幅提升。以文中展示 “思维链” 过程时列举的编程问题为例,o1 解答时,加上思维链,处理的字符有 6632 个,是 GPT-4o 的 4.2 倍 。更长的计算时间和更长的输出都意味着更高的算力成本。

o1 对 AI 前景和算力消费的刺激很快反映在资本市场。自本周初有媒体报道 OpenAI 即将发布新模型后,英伟达股价累计回升 10%,微软也一起上涨。

对于那些不确定技术演进方向或者一度放缓研究基础模型的公司,现在又有新工作可以做,有新方向可以卷了。o1 的发布大概率意味着,在 “推理模型” 上,竞争差距再一次拉开,一轮加速追赶和投入即将发生。

“是时候正经干点正事了,要不真的就不在游戏里了。” 一位中国大模型研究者说。